AMD发布第二代Versal自适应SoC:10倍标量性能、全程AI加速

快科技4月9日消息,AMD今天宣布,旗下的Versal自适应片上系统(SoC)产品升级全新第二代,包括面向AI驱动型嵌入式系统第二代的Versal AI Edge系列、面向经典嵌入式系统的第二代Versal Prime系列。

新一代产品很好地平衡了性能、功耗、面积,以及先进的功能安全与信息安全,可广泛应用于汽车、工业、视觉、医疗、广播、专业音视频等市场领域。

新品在单器件内集成了预处理、AI推理、后处理,可为AI嵌入式系统提供端到端的全程加速。

这也是AMD董事会主席及CEO苏姿丰此前提出的“AI无处不在”战略的最新体现。

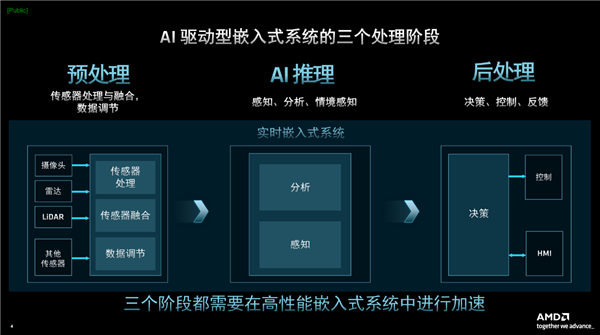

对于AI驱动的嵌入式系统,核心当然是AI推理,也就是AI算法执行的阶段,但是预处理、后处理两个阶段同样不容忽视。

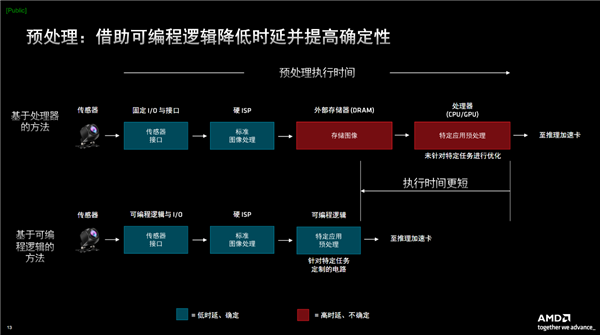

一般而言,预处理阶段主要是摄像头、雷达、激光雷达等传感器的处理、融合,以及数据的交集和调节。

这一阶段需要嵌入式系统与环境进行实时交互与处理,决定着整个系统的性能,因此需要可编程逻辑来实现灵活的实时处理,包括连接任意传感器和接口,保证低时延、确定性,以及现场部署后依然可升级,一般还要加上FPGA、SoC进行优化。

AI推理阶段需要实时嵌入式系统解决感知、分析、情境感知问题,一般使用矢量处理器,也就是非自适应性SoC。

后处理阶段需要实现决策、控制、反馈,一般使用高性能嵌入式CPU。

这三个阶段都必须能够加速,才可以真正实现全系统的实时。

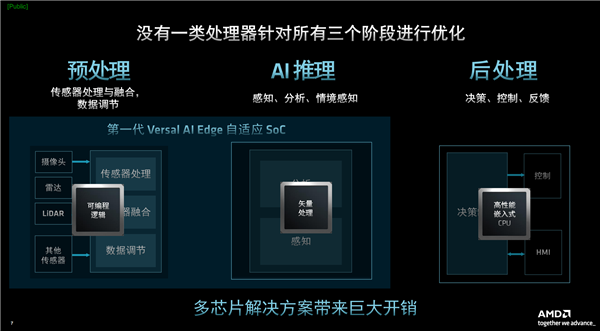

但是,之前没有任何一类处理器可以同时针对三个阶段进行优化加速,都需要多芯片共同组成解决方案。

比如说用AMD第一代Versal AI Edge系列的可编程逻辑做预处理,然后用矢量处理或者AI引擎做推理,后处理阶段再配置外部处理器。

类似方案都存在功耗更高、供电更复杂、占用空间更大、外部内存需求更多、芯片间时延更长等问题,还容易存在更多安全漏洞。

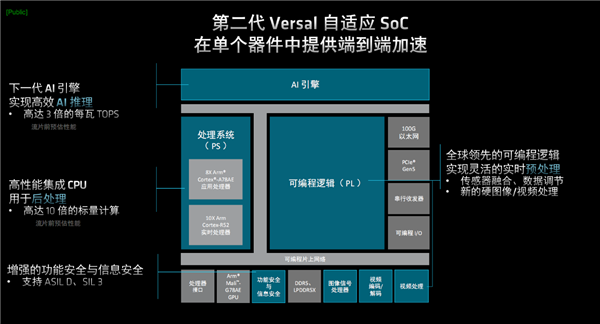

AMD的第二代 Versal 系列自适应SoC以第一代为基础升级而来。

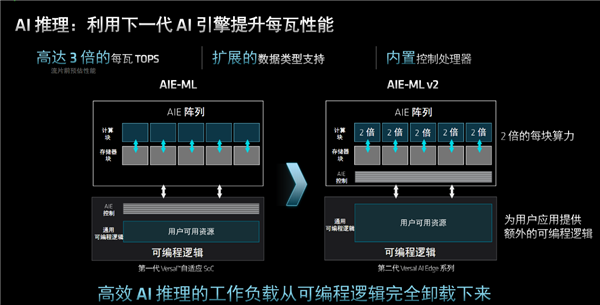

无论是面向AI驱动型嵌入式系统的AI Edge系列,还是面向经典嵌入式系统的Prime系列,同样具备强大的全新AI引擎,每瓦TOPS算力(即能效)是第一代AI Edge系列的最多3倍。

处理系统部分(PS)集成了全新的高性能Arm CPU核心,包括Cortex-A78AE应用处理器核心、Cortex-R52实时处理器核心,标量计算性能预计可比第一代提升最多10倍,

全新的AMD可编程逻辑(PL),具备领先的自适应计算能力,可实现灵活的实时预处理。

此外还集成了Arm Mali-G78AE GPU图形核心、DDR5/LPDDR5X内存控制器、PCIe 5.0控制器、100G以太网控制器、DPS图像信号处理器、视频编解码器、功能与信息安全模块、处理器接口、视频处理单元等等众多单元,单颗芯片搞定一切。

正因为如此,AMD第二代Versal才是真正的自适应SoC,才能在单个器件中提供端到端的全程加速。

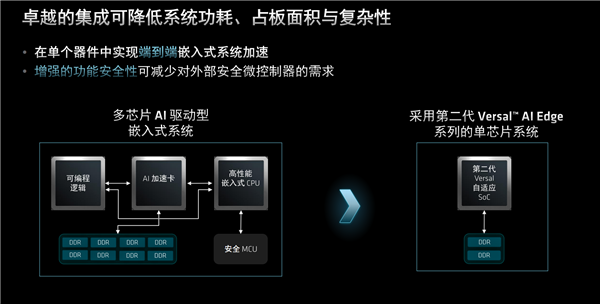

单芯片设计的高级程度,还可以大大降低系统功耗、占用空间、复杂性。

功能安全性增强之后,也不再需要外部安全微控制器,或者外部存储,不需要在多个处理器之间共享。

第二代Versal AI Edge系列器件通过采用最优处理器组合,能够为AI驱动型嵌入式系统的全部三个阶段进行加速,满足现实系统的复杂处理需求。

在预处理阶段,AMD FPGA可编程逻辑架构用于实时处理,可以密集、灵活地连接各种传感器,包括各种图像传感器、摄像头、激光雷达、超声波、定位系统、IMU惯性测量单元、内窥镜探头等等,并进行高吞吐量、低时延的数据处理。

可编程逻辑的引入,能够摆脱对外部存储、CPU/GPU处理器的依赖,并针对特定任务进行定制优化,从而直接连接到推理加速卡,大大节省执行时间。

可编程I/O则支持广泛的不同传输速率、电压和工作模式,相比固定I/O更加灵活。

推理阶段,矢量处理器阵列构成了下一代 AI引擎“AIE-ML v2”。

它内置硬化控制处理器,不再需要使用可编程逻辑进行控制,因此可以将可编程逻辑资源释放用于传感器、硬图像和视频等数据的处理。

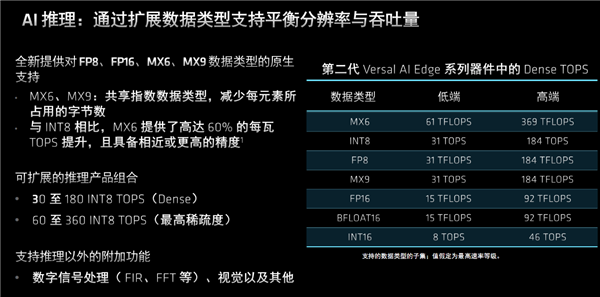

新的AI引擎还原生支持更多数据类型,包括全新的FP8、FP16、MX6、MX9,并继续支持INT8、INT16、BF16。

Dense性能方面,INT16算力最高46TOPS,FP16、BF16算力最高92TOPS,INT8、FP8、FPMX9算力最高184TOPS,MX6算力最高369TOPS。

最高稀疏度算力更高,比如INT8最高可以达到368TOPS。

MX6、MX9属于共享指数数据类型,可以节省每个元素所占用的字节数,其中MX6对比INT8的能效可提升多达60%,而且精度类似甚至更高。

为了充分释放AI引擎的算力性能,AMD同时提供了Vitis AI开发环境,提供丰富的量化器、剪枝、模型编译器与工具、运行时、驱动、固件等全套开发资源,以及培训、文档、参考设计等。

它还支持开源生态系统,采用行业标准框架,包括PyTorch、TensorFlow、ONNX、Triton等等,也支持第三方量化器和稀疏工具。

对于各种模型、运算符、数据类型,Vitis AI环境都支持开箱即用,包括卷积神经网络(CNN)、视觉Transformer等等。

后处理阶段,Arm CPU内核可为安全关键型应用提供复杂决策与控制所需的能力。

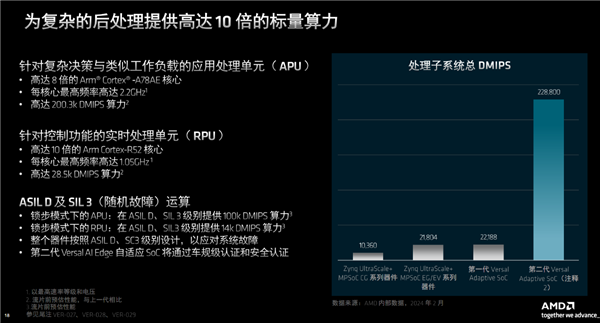

针对复杂决策与繁重工作负载的应用处理单元(APU),基于Arm Cortex-A78AE核心,最高频率2.2GHz,算力高达200.3K DMIPS,是上代的最多8倍。

针对控制功能的实时处理单元(RPU),则基于Arm Cortex-R52核心,最高频率1.05GHz,算力高达28.5K DMIPS,是上代的最多10倍。

另外,因为未来需要通过车规级认证、安全认证,尤其是高级别型号会用于ASIL D汽车、SIL 3工业和机器人领域,必须应对随机故障,确保功能安全与信息安全,所以在锁步模式下算力性能会减半,以便留出足够的冗余空间。

当然,理论指标和性能最终要转化为实际应用,才能真正体现出来。

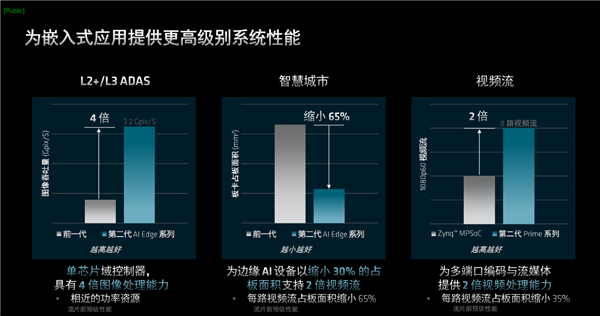

比如高级自动驾驶辅助系统L2+/L3,由于加入硬图像处理功能,图像处理性能可达上代的4倍,但功耗基本不变。

比如智慧城市,往往需要大量摄像头和视频,可以为边缘AI设备缩小30%的占板面积,比并支持2倍的视频流,也就是每路视频流占板面积缩小多达65%。

再比如视频流,一般用于专业音视频和广播场景,可实现非常高精度的流量,每秒约60帧,相比于之前的Zyng MPSoC可提供2倍的视频处理能力,每路视频流占板面积也缩小35%。

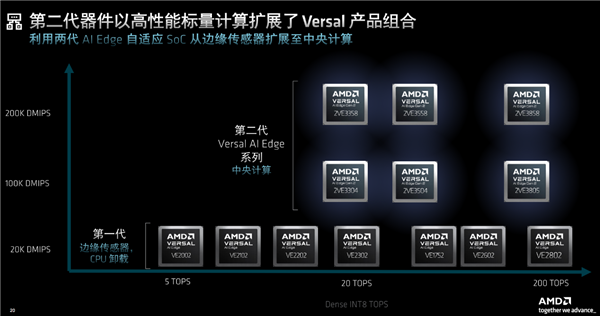

两代产品性能级别对比,可以看到没有任何交叉重叠,可以互为补充、针对不同应用和场景。

上一代产品更多的是边缘传感器后者CPU计算卸载,二代产品则主要是中央计算。

合作案例方面,斯巴鲁已选择第二代Versal AI Edge系列,用于其下一代高级辅助驾驶(ADAS)的视觉系统“EyeSight”。

该系统会集成于斯巴鲁的部分车型,实现先进安全功能,包括自适应巡航控制、车道保持辅助、预碰撞制动等等,致力于实现全年消除致命性道路事故的安全目标。

第二代Versal Prime系列结合了面向传感器处理的可编程逻辑,以及高性能嵌入式Arm CPU,可以为传统的非AI嵌入式系统提供端到端加速。

它也能提供最多10倍与初代产品的标量算力,高效执行传感器处理、复杂标量工作负载。

同时,得益于针对8K等高吞吐量视频处理的全新硬 IP,第二代Versal Prime系列非常适合超高清视频流与录制、工业PC等应用。

AMD第二代Versal AI Edge系列、第二代Versal Prime系列将于2025年上半年提供样品,2025年年中提供评估套件和系统模块(SOM),2025年年底量产上市。

目前,客户和开发者已经可以获取早期访问文档、参与早期使用计划,AMD也正在与主要客户进行接洽。

版权声明

本站所有文章来源于本站原创或网络,如有侵权请联系删除。文章观点并不代表本站观点,请网友自行判断,如涉及投资、理财请谨慎应对!

德阳吧

德阳吧

发表评论:

◎欢迎参与讨论,请在这里发表您的看法、交流您的观点。