OpenAI又上演权力的游戏

伟大的技术、产品公司,有时会折戟于管理。就好比巅峰期的雅达利因质量品控体系松弛而崩溃。

技术和管理到底能否兼具?类似的考题,被摆在OpenAI面前。

5月15日,GPT-4o发布后仅一天,OpenAI再次成为了万众瞩目的焦点。不过与此前的技术突破不同,此次OpenAI的话题点在于,开始其首席科学家Ilya和超级对齐团队的集体出走。此前,超级对齐团队曾拥有OpenAI20%的算力资源。因此难免让人怀疑,此次OpenAI短时间、大规模的人事变动是否是其发展战略变动的前哨?

分歧已久

OpenAI内部的分歧存在已久,在去年11月的“宫斗”事件中早已公之于众。此次IlyaSutskever等一行人的出走,可以看作是历史矛盾的延续。Ilya辞职前,OpenAI内部最大的分歧之一在于对AI安全问题的态度上。科技巨头和初创公司的互卷下,AI技术研发在快车道上一往直前,AGI时代离我们也越来越近。有人认为“OpenAI正在训练更强大的AI系统,目标是最终全面超越人类智能”。未知的全新力量下蕴藏着未知的风险。用前员工的一句话讲,这可能是人类有史以来发生过的最好的事情,但如果我们不小心行事,也可能是最糟糕的事情。

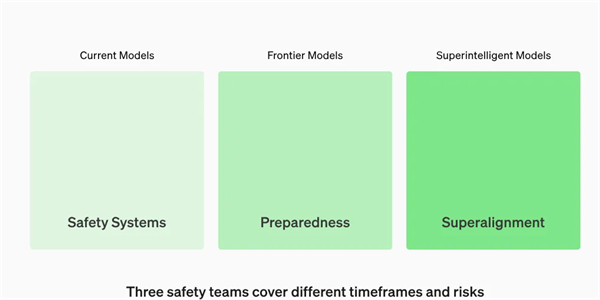

当前的AI监管主要集中于“评估风险和采取缓解措施”的组合上,这种组合很容易被大型公司钻空子,最终反而疏于了对最需要被监管的前型AI实验室的监管。超级对齐团队解散前,对于不同时间尺度的AI风险,OpenAI有三个团队来分别应对。

“对齐”或“超级对齐”是人工智能领域中使用的术语,指训练人工智能系统在人类需求和优先事项范围内运行的工作。2023年6月5日,超级对齐AI团队首次对外宣布成立。这支团队的使命旨在“解决如果公司成功构建AGI,实际上会出现不同类型的安全问题”——也就是AI智能水平不断提高后未来可能出现的安全问题。

师从人工智能教父GeoffrayHinton的Ilya是坚持安全第一的安全派。2016年,Ilya以联合创始人、研究总监的身份加入OpenAI,并于2018年担任首席科学家。研发期间,Ilya一直在关注AI大模型的安全问题。

SamAltman则是商业派,致力于开发“更闪亮的产品”,与谷歌等竞争对手的卯足了劲较量。在他看来,AGI的安全治理问题优先级远远不如推出“闪亮的产品”。虽然Altman在采访中屡次表示对安全问题的重视,但就实际操作而言,算力资源的天平在不断向着研发的一侧倾斜。对于Altman来说,相对于未来态的安全治理,如何加足马力在当前的这场AI竞赛中拔得头筹显然更为重要。

对此,OpenAI的前员工、超级对齐成员之一WilliamSaunders在LessWrong论坛上表示,对OpenAI能否在AGI时代负责任的行动失去了信心。

WilliamSaunders并非个例。对OpenAI未来AGI安全部署工作的失望成为超级对其团队不少人离开的关键要素。不少人认为,Ilya出走很可能是已经看到了AGI的安全隐患。

OpenAI“权力的游戏”还有几季?

在技术驱动的进步面纱下,未来安全团队被迫“重组”。事实上,OpenAI在安全方面的人事一直在不断“跳跃”。

2021年,GPT-3的团队负责人Dario和DanielaAmodei因“对安全研究的优先次序”存在分歧而辞职,转身创办了Anthropic。

同年,RLHF的发明者兼安全研究主管Dr.PaulChristiano从安全团队中辞职,创办了一个非盈利性的校准研究中心。

2023年11月,OpenAI围绕安全问题爆发宫斗,SamAltman在被撤职100小时后重返OpenAI。

2024年,这场“权力的游戏”继续上演。

2024年2月15日,安全研究员WilliamSaunders在EA论坛上总结了自己在OpenAI作为超级对齐团队一部分的工作。表示已从OpenAI辞职。

3月17日,JanLeike离职。JanLeike参与开发了ChatGPT的核心技术之一——人类反馈强化学习RLHF,在其加入OpenAI后,从代码大模型Codex、ChatGPT的前身InstrucGPT,到ChatGPT、GPT-4,他都是重要贡献者。

4月,DanielKokotajlo在拒绝签署离职协议的情况下辞职,并在此后的媒体采访中公开表示“OpenAI正在训练更强大的AI系统,目标是最终全面超越人类智能。”,自己已经“逐渐对OpenAO领导层以及他们负责地处理AGI的能力失去了信心”。

4月11日,安全团队的LeopoldAschenbrenner与推理团队的PavelIzmailov因涉嫌信息泄密而被开除。安全研究员CullenO'Keefe也离开了OpenAI。

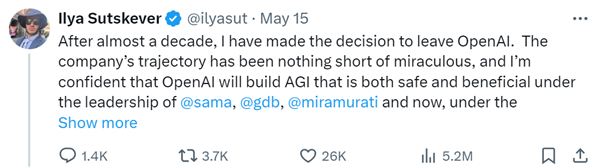

5月15日,OpenAI的联合创始人及首席科学家Ilya宣布离职,并在社交平台X上表示自己将开启“接下来的计划——这个项目对我个人来说意义重大,我会在适当的时候分享细节。”

Ilya宣布离开几小时后,Ilya的同事,OpenAI超级对齐团队联合主管JanLeike光速宣布辞职,在X上留下两个字母:Iresigned。Leike自2021年加入OpenAI,并于2023年开始领导超级对齐团队。在此后几天,JanLeike陆续在X上揭开此次出走的“内幕”:“我与OpenAI领导层在公司的核心优先事项上存在分歧已有一段时间,直到我们最终达到了临界点”“过去几个月,我的团队一直在逆风前行”“建造比人类更聪明的机器本质上是一项危险的工作……但在过去的几年里,安全文化和流程已经让位于闪亮的产品”。他认为OpenAI“应该把更多的精力花在为下一代模型做准备上,包括安全性、监控、准备、安全、对抗鲁棒性、(超级)对齐、保密性、社会影响和相关主题,这些问题很难解决,我担心我们还没有走上正确的轨道。”

超级对齐成员之一WilliamSaunders,以及参与过GPT-4对抗性测试的DanielKokotajlo,此前两人均已离开OpenAI。

在诸多离职的人中,DanielKokotajlo和JanLeike属于敢直接批判OpenAI在安全领域和发展方向存在问题的“特殊群体”。个中原因很可能是OpenAI的“封口协议”。根据OpenAI前员工KelseyPiper爆料,OpenAI的员工需签署一份带有非贬低协议的离职协议,如果拒绝签署,其拿到的股权获益将被取消。而DanielKokotajlo则拒绝签署这一协议。

在Sutskever和Leike退出后,OpenAI向CNN证实,最近几周已开始解散其超级对齐团队,转而整合各个研究小组的团队成员。OpenAI的发言人表示,该结构将帮助OpenAI更好地实现其超级对齐目标。事实上,该业务线新的领导者JohnSchulma此前是负责OpenAI现有产品的安全问题。而将纵向超级对齐团队横向合并也意味着,未来安全把关人在一定程度上的消失。

浮世新人换旧人,SamAltman在社交平台X上表达了对于Ilya离开的遗憾,表示“他走后的OpenAI不再和从前一样”,但旋即又在同一条帖子宣布任命了新的首席科学家JakubPachoki。此外,OpenAI近日还聘请了在Google搜索广告业务工作了多年的资深人士ShivakumarVenkataraman。

自此,OpenAI的发展战略阶段性地实现了表面一致——以“党同伐异”的代价。

版权声明

本站所有文章来源于本站原创或网络,如有侵权请联系删除。文章观点并不代表本站观点,请网友自行判断,如涉及投资、理财请谨慎应对!

德阳吧

德阳吧

发表评论:

◎欢迎参与讨论,请在这里发表您的看法、交流您的观点。